L’intelligenza artificiale sta assumendo un ruolo sempre più rilevante nel settore sanitario, con milioni di persone che si affidano quotidianamente a ChatGPT per ottenere informazioni su sintomi, farmaci e opzioni di trattamento. L’integrazione di questa tecnologia nella vita quotidiana solleva Questioni importanti riguardo ai limiti dell’uso dell’AI in ambito medico.

chatgpt e l’utilizzo nei quesiti sanitari quotidiani

Secondo un rapporto recente pubblicato da OpenAI, circa 40 milioni di utenti utilizzano ogni giorno ChatGPT per domande legate alla salute. Questo dato evidenzia come l’assistente virtuale sia diventato uno strumento diffuso per ricevere risposte rapide senza dover consultare direttamente fonti mediche o navigare in rete. Le richieste più frequenti riguardano:

- sintomi associati a varie condizioni;

- informazioni su farmaci;

- possibili trattamenti;

- orientamento in sistemi sanitari spesso sovraccarichi.

I dati indicano inoltre che oltre il 5% delle domande poste a ChatGPT riguarda tematiche sanitarie, con circa 200 milioni di utenti settimanali che pongono almeno una domanda inerente alla salute.

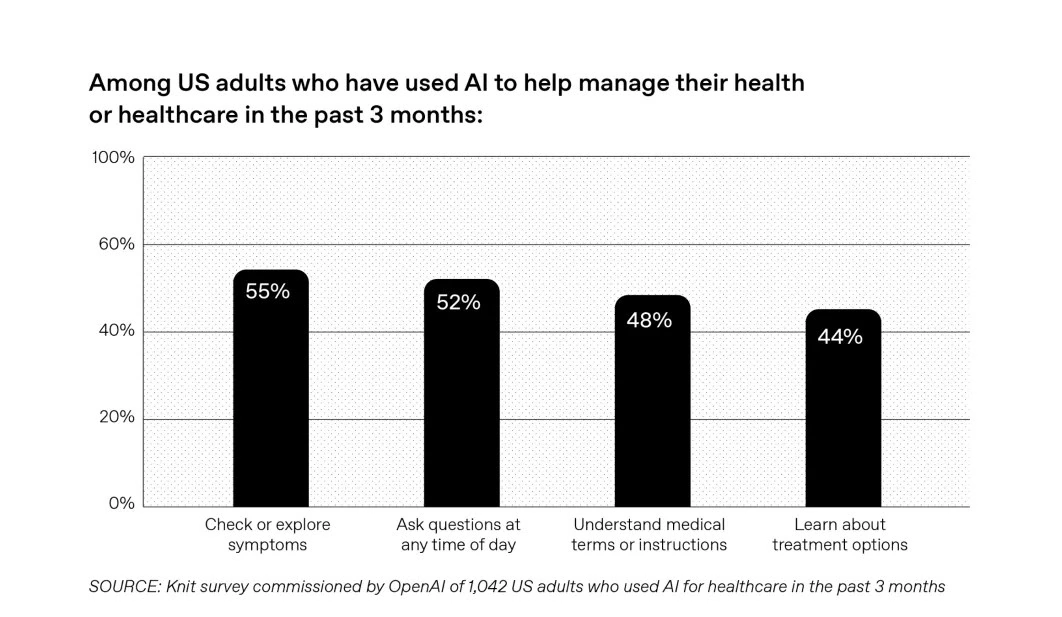

dati statistici sull’uso di chatgpt per la salute negli stati uniti

Il rapporto si basa su un sondaggio condotto su 1.042 adulti residenti negli Stati Uniti, dal quale emerge che:

- il 55% degli intervistati utilizza ChatGPT per verificare o approfondire sintomi;

- il 52% dichiara di porre domande sanitarie all’assistente AI in qualsiasi momento;

- quasi il 48% impiega ChatGPT per comprendere termini medici o istruzioni correlate.

Anche se non è consigliabile affidarsi esclusivamente a chatbot per la diagnosi o il trattamento, il report segnala che il 44% degli utenti chiede al sistema informazioni sulle possibili terapie da intraprendere, sottolineando così una crescente dipendenza dall’intelligenza artificiale quando i canali sanitari tradizionali risultano temporaneamente indisponibili.

chatgpt come supporto nella valutazione sanitaria senza sostituire i medici

OpenAI ribadisce che ChatGPT può essere utile nell’analisi preliminare delle condizioni di salute ma non può né deve sostituire il parere medico qualificato. Un esempio riportato nel documento riguarda Ayrin Santoso da San Francisco: dopo aver inserito i sintomi e la storia clinica della madre colpita da improvvisa perdita della vista in Indonesia, l’assistente ha suggerito la possibilità di una crisi ipertensiva o ictus. Grazie a questo avvertimento, Santoso ha portato tempestivamente la madre in ospedale, dove è stata recuperata il 95% della vista nell’occhio interessato.

Tuttavia, è fondamentale ricordare che ChatGPT fornisce solo indicazioni informative e non garantisce accuratezza assoluta. Per questo motivo molte aziende tecnologiche includono disclaimer nei loro assistenti AI specificando che possono commettere errori. Affidarsi esclusivamente ad un sistema non infallibile per gestire patologie rappresenta dunque una pratica rischiosa e sconsigliata.

Lascia un commento