un quadro legale recente mette a confronto la west virginia con apple, accusando la società di non aver adottato misure adeguate per prevenire la condivisione di materiale di abuso sessuale su csam attraverso icloud e altri servizi. l’azione evidenzia lacune percepite nell’approccio al rilevamento di contenuti illeciti, a fronte di strumenti più evoluti disponibili nel settore. d altra parte, apple sostiene un impegno costante per la protezione dei minori e la privacy degli utenti all’interno del proprio ecosistema digitale.

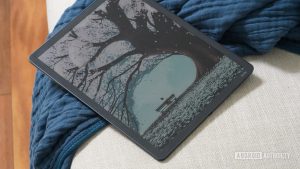

apple affronta una nuova causa per non aver impedito la diffusione di csam su icloud

l’avvocato generale JB McCuskey ha sottolineato che la querela si concentra su cosiddette lacune nell’approccio di apple al rilevamento del csam sui dispositivi e sui servizi cloud. secondo l’accusa, altre grandi aziende tech utilizzano sistemi automatizzati di hashing per identificare e bloccare immagini illegali note, mentre apple avrebbe trascurato strumenti avanzati, lasciando margine di circolazione di contenuti dannosi all’interno dell’ecosistema iCloud.

nel testo della denuncia, si afferma che la scelta di non implementare in modo permanente tali strumenti ha creato opportunità per la diffusione di file dannosi all’interno dello spazio di archiviazione di iCloud, compromettendo la sicurezza degli utenti e la conformità normativa in materia di protezione dei minori.

in passato, apple aveva annunciato nel 2021 un piano per analizzare alcune foto caricate in iCloud negli Stati Uniti, confrontando dati delle immagini con una banca dati di materiale abusivo. se il parametro di soglia fosse stato raggiunto, sarebbero stati generati rapporti. Dopo mesi di dibattito pubblico, la funzione fu sospesa e poi abbandonata, con l’azienda che dichiarò la necessità di trovare un equilibrio tra sicurezza e privacy.

gli avvocati di stato chiedono quindi sanzioni economiche e un’ordinanza giudiziale che imporrebbe ad apple l’adozione di sistemi di rilevamento CSAM. la parte pubblica sostiene che tali strumenti dovrebbero restare operativi in via permanente, per garantire una protezione più efficace contro contenuti illegali.

in risposta, apple ribatte che la protezione della sicurezza infantile e la privacy degli utenti restano valori centrali. l’azienda richiama anche i suoi strumenti di controllo parentale e le misure di sicurezza delle comunicazioni, che avvertono i giovani quando vengono rilevati contenuti sensibili in messaggi, foto condivise, AirDrop o chiamate FaceTime. inoltre, apple continua a investire in sistemi avanzati per salvaguardare la privacy e i dati degli utenti, sostenendo un orizzonte orientato all’innovazione responsabile.

Lascia un commento