Recenti eventi hanno evidenziato l’uso di modelli di intelligenza artificiale, come Claude sviluppato da Anthropic, da parte di hacker sostenuti dallo stato cinese. Questa serie di attacchi informatici rappresenta una delle campagne più avanzate mai osservate, con un livello di automazione senza precedenti. Secondo quanto riportato dal Wall Street Journal, Claude è stato impiegato per automatizzare circa 30 tentativi di hacking su sistemi aziendali e governativi nel mese di settembre, gestendo il 90% dell’intero flusso di lavoro.

Hacker cinesi utilizzano Claude di Anthropic per attacchi

Jacob Klein, responsabile dell’intelligence in Anthropic, ha confermato che gli hacker sono stati in grado di eseguire sequenze complesse e prolungate con un semplice clic. L’automazione raggiunta in questo attacco supera notevolmente i casi precedenti di uso improprio del modello. Gli aggressori sono riusciti a rubare dati sensibili da quattro vittime, ma Anthropic non ha fornito dettagli specifici sulle organizzazioni o sugli individui colpiti.

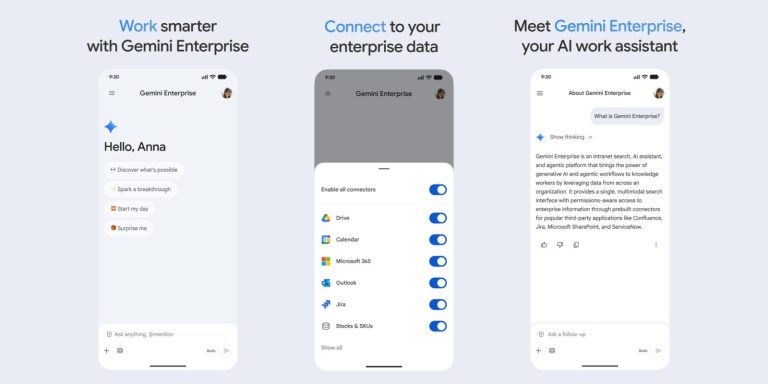

L’influenza dell’intelligenza artificiale nel crimine informatico è in costante crescita. Diverse aziende tecnologiche importanti, tra cui Google, hanno segnalato che i criminali informatici stanno sperimentando l’AI per supportare le operazioni malware. Recentemente, Google ha rivelato che alcuni hacker legati alla Russia utilizzano modelli linguistici avanzati per generare comandi e migliorare l’efficienza dei loro attacchi malware.

La Cina sfrutta l’AI per raccogliere dati sensibili

Funzionari statunitensi hanno ripetutamente avvertito riguardo all’uso dell’AI da parte della Cina per raccogliere informazioni riservate da aziende e cittadini americani; La Cina ha negato tali accuse. D’altro canto, Anthropic ha affermato di avere fiducia nel fatto che gli aggressori fossero collegati al governo cinese e ha confermato che nessun dato del governo americano è stato compromesso.

Claude sta diventando la scelta preferita degli hacker per condurre campagne malware. In un caso precedente, Claude era stato coinvolto in uno schema estorsivo noto come “vibe-hacking”, che mirava ad almeno 17 organizzazioni con una richiesta di riscatto pari a $500.000 per non divulgare i dati rubati. Questi eventi dimostrano che gli attacchi informatici assistiti dall’AI stanno aumentando a un ritmo senza precedenti; ciò che richiedeva abilità tecniche considerevoli è ora parzialmente automatizzato.

Lascia un commento